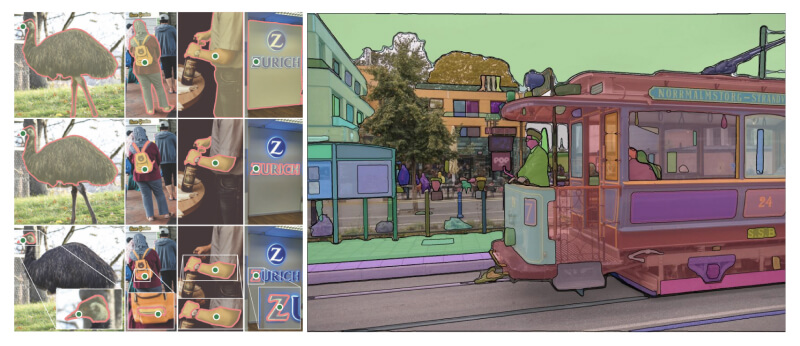

Segment Anything Model(SAM)是Meta AI研究院最新推出的圖像分割模型,該模型通過(guò)點(diǎn)或框等輸入提示生成高質(zhì)量的物體遮罩,并且可以用于為圖像中的所有物體和對(duì)象生成遮罩。SAM模型在超過(guò)1100萬(wàn)張圖像和11億張掩模的數(shù)據(jù)集上進(jìn)行了訓(xùn)練,并且在各種圖像分割任務(wù)上具有強(qiáng)大的零樣本性能,大家快來(lái)AI365導(dǎo)航!

??版權(quán)聲明:若無(wú)特殊聲明,本站所有文章版權(quán)均歸奇想AI導(dǎo)航網(wǎng)原創(chuàng)和所有,未經(jīng)許可,任何個(gè)人、媒體、網(wǎng)站、團(tuán)體不得轉(zhuǎn)載、抄襲或以其他方式復(fù)制發(fā)表本站內(nèi)容,或在非我站所屬的服務(wù)器上建立鏡像。否則,我站將依法保留追究相關(guān)法律責(zé)任的權(quán)利。