Aya Vision 是 Cohere 開發的一種多模態、多語言視覺模型,發布于 2025 年 3 月 3 日,旨在提升全球范圍內的多語言和多模態通信能力。根據 Cohere 博客:Aya Vision:擴展 AI 所能看到的世界,該模型支持 23 種主要語言,覆蓋全球一半以上人口的語言需求,特別適合多語言環境下的視覺內容處理。

主要功能

Aya Vision 的功能設計全面,涵蓋以下幾個方面:

-

圖像描述生成

該功能允許用戶上傳圖像,模型生成準確且詳細的描述文本。這對于視覺障礙人士或需要快速提取圖像信息的場景尤為重要。例如,學生可以通過圖像描述快速了解藝術品的風格和起源,增強學習體驗。 -

視覺問答(VQA)

用戶可以上傳圖片并提出相關問題,Aya Vision 結合視覺信息和語言理解能力,提供準確的答案。這種交互式功能在教育和內容創作領域具有廣泛的應用潛力,例如教師可以用它回答學生關于生物圖譜的問題。 -

多語言支持

Aya Vision 支持 23 種主要語言,能夠處理多語言的文本輸入和輸出。 -

文本翻譯與摘要生成

除了視覺任務,Aya Vision 還能翻譯文本內容并生成簡潔的摘要,幫助用戶快速獲取關鍵信息。這在跨語言交流和信息處理中尤為實用,例如研究人員閱讀外文論文時可快速獲取要點。 -

跨模態理解與生成

該模型能夠將視覺信息與語言信息相結合,實現跨模態的交互。例如,它可以將圖像內容轉化為文本描述,或將文本指令轉化為視覺搜索結果,這在廣告創意或內容生成中非常有用。

技術原理

Aya Vision 采用模塊化架構,包含以下核心組件:

-

視覺編碼器:基于 SigLIP2-patch14-384,負責提取圖像特征。

-

視覺語言連接器:將圖像特征映射到語言模型的嵌入空間。

-

語言模型解碼器:用于生成文本輸出。

訓練過程中,Aya Vision 使用合成標注(由 AI 生成的標注)進行訓練,通過翻譯和重述處理增強多語言數據的質量。模型還采用了動態圖像分辨率處理和像素混洗下采樣技術,提高計算效率。根據 TechCrunch:Cohere 聲稱其新 Aya Vision AI 模型為最佳,盡管參數規模較小(8B 和 32B),Aya Vision 在多個基準測試中超越了更大規模的模型,如 Llama-3.2 90B Vision,這得益于高效的訓練策略和對計算資源的優化。

訓練分為兩個階段:

- 視覺語言對齊:確保圖像和文本表示的一致性。

- 監督微調:在多模態任務上聯合訓練連接器和語言模型。

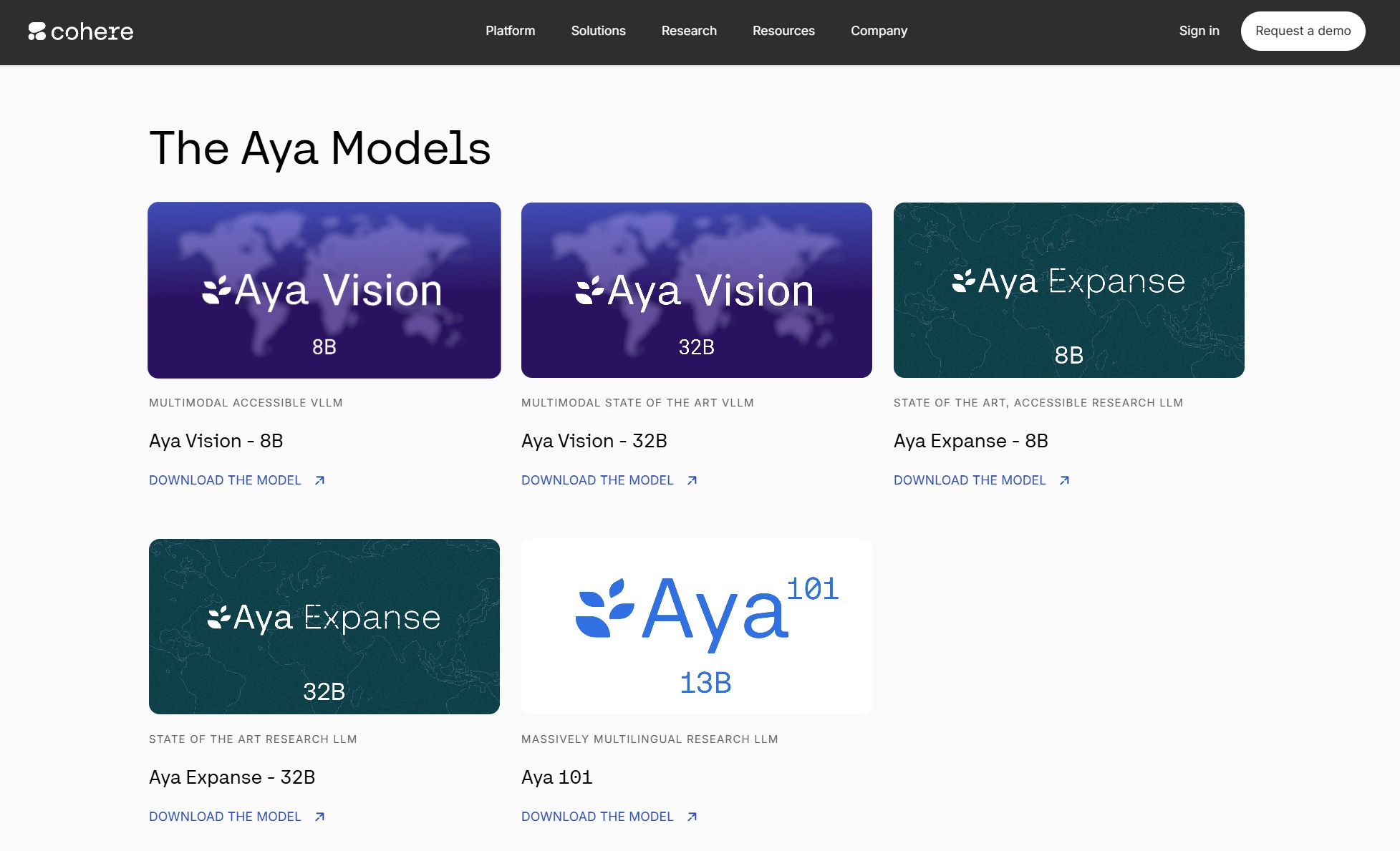

版本與性能

Aya Vision 提供兩個版本:Aya Vision 32B 和 Aya Vision 8B。根據 Hugging Face:CohereForAI/aya-vision-8b 和 Hugging Face:CohereForAI/aya-vision-32b,32B 版本參數更多,適合需要更高性能的場景,而 8B 版本更注重計算效率,適合資源受限的環境。用戶可以根據具體需求選擇,例如研究機構可能偏向 32B,而小型企業可能更適合 8B。

應用場景

Aya Vision 的應用場景廣泛,涵蓋以下領域:

- 教育領域

它可以幫助學生和教師更好地理解視覺內容。例如,通過圖像描述功能,學生可以快速了解藝術品的風格和起源,教師可以用它創建交互式課程。 - 內容創作

Aya Vision 能為多語言網站生成圖像描述,提升用戶體驗。它還可以用于生成創意內容,如新聞報道、故事或詩歌,特別適合全球化的內容平臺。 - 輔助工具

對于視覺障礙人士,Aya Vision 可以作為輔助工具,通過圖像描述幫助他們理解周圍環境。例如,智能手機應用可集成該模型,為用戶實時描述相機捕捉的圖像。 - 多語言翻譯與交流

支持 23 種語言的文本翻譯和摘要生成,能幫助用戶跨越語言障礙進行交流,特別適合國際商務或旅游場景。 - 研究與開發

研究人員可以基于 Aya Vision 的高效性和多語言支持能力,探索新的應用場景,例如開發多語言視覺輔助系統或分析跨文化視覺內容。

開放源代碼與可訪問性

Cohere 以 Creative Commons Attribution-NonCommercial 4.0 International (CC BY-NC 4.0) 許可發布了 Aya Vision,允許研究人員和開發者在非商業用途下自由使用、修改和分享模型,前提是提供適當的署名。模型可在 Cohere 網站、Hugging Face:CohereForAI/aya-vision-8b、Hugging Face:CohereForAI/aya-vision-32b 上獲取,用戶還可以通過 Cohere Playground 或 WhatsApp 與模型交互。這種開放性和可訪問性鼓勵了 AI 社區的協作與創新。

性能對比與基準測試

研究表明,Aya Vision 在多個基準測試中表現出色,特別是在多語言和多模態任務上。根據 RoboFlow 博客:Cohere Aya Vision:多模態和視覺分析,8B 版本在與近期發布模型的定性測試中表現優異,而 32B 版本則在更復雜的任務上展現出更強的能力。這使得 Aya Vision 成為資源受限環境下的理想選擇,同時也適用于高性能需求場景。

未來展望

Aya Vision 的發布標志著多模態 AI 向更包容、更高效的方向發展。其多語言支持和開放源代碼特性可能激勵更多開發者參與創新,特別是在教育、輔助技術和全球通信領域。隨著 AI 技術的持續進步,Aya Vision 可能成為連接不同文化和語言的橋梁。

數據表:Aya Vision 關鍵參數對比

| 版本 | 參數規模 | 主要優勢 | 適用場景 |

|---|---|---|---|

| Aya Vision 8B | 8 億 | 計算效率高,資源占用少 | 小型企業、移動應用 |

| Aya Vision 32B | 32 億 | 性能更強,處理復雜任務 | 研究機構、高性能需求場景 |

結論

Aya Vision 作為 Cohere 的一項創新成果,憑借其高效的性能、多模態和多語言支持能力,正在為全球用戶提供全新的視覺內容處理體驗。無論是教育、內容創作,還是研究開發,Aya Vision 都展現出了巨大的潛力。如果您正在尋找一款功能強大、易于使用的視覺模型,Aya Vision 絕對值得一試。